Sommaire

L'analyse et l'indexation sont deux conditions préalables pour qu'un site Web soit répertorié dans les résultats de la recherche.

Cette tâche est prise en charge par Googlebot. Cependant, seul un budget d'analyse limité est disponible. Pour qu'un site Web soit analysé et indexé de manière optimale, le budget d'analyse doit être optimal être épuisé.

Qu'est-ce que le budget d'analyse?

Le budget d'analyse est défini par Google comme étant la somme de la fréquence d'analyse et de la demande d'analyse. Le budget lui-même comprendra un nombre défini d'URL que Googlebot est autorisé à analyser et à analyser. Gary Illyes de Google fournit une explication plus détaillée du budget d'analyse dans l'article largement acclamé "Que représente le budget d'analyse pour Googlebot", qui a été publié sur Google Webmaster Central le 16 janvier 2017. Les notes et les explications sont maintenant expliquées pièce par pièce.

Voici comment les pages Web sont explorées et indexées

Googlebot est un programme qui collecte des documents sur le Web, suit les URL et indexe les documents Web des pages que vous visitez. En général, le travail de Googlebot repose sur quatre étapes principales:

premier Google trouve une URL, par exemple via des liens internes, un sitemap XML ou des liens entrants.

deuxième À partir des liens trouvés, une liste est créée, au sein de laquelle les URL individuelles sont classées par ordre de priorité pour l'analyse.

troisième Ultérieurement, Googlebot recevra le "budget d'analyse". Il détermine à quelle vitesse les URL d'un site Web sont explorées.

4 Un programme appelé "ordonnanceur" contrôlera ensuite Googlebot et le laissera exécuter les URL en fonction de sa priorité et de son budget d'analyse.

Tout ce processus est continu. Cela signifie que de plus en plus d'URL seront ajoutées à la liste à mesure que Googlebot explorera et indexera les URL. Le budget d'analyse est ajusté à chaque fois.

Il est important que Googlebot n’ait pas à épuiser son budget d’exploration. Parce qu’en plus de la fréquence d’exploration, seuls les besoins d’exploration jouent un rôle. Si Google ne considère pas les URL comme importantes, leur analyse peut également être annulée. Il y a plus de ressources disponibles pour d'autres URL.

Pourquoi l'exploration et l'indexation sont importantes

Pour que les pages Web aient un classement, elles doivent d'abord être explorées et indexées. La visite de Googlebot est donc une condition préalable absolue pour qu'un site Web apparaisse dans les résultats de recherche.

Il est donc important pour les webmasters que les URL puissent être trouvées. En outre, Google doit trouver l'URL suffisamment élevée pour que la liste d'analyse soit prioritaire. Google lui-même, par exemple, explorera moins et moins fréquemment les pages moins bien entretenues et sans contenu que les pages de haute qualité.

Toutefois, Google peut facilement analyser des pages Web contenant moins de 1 000 URL, quel que soit le budget d'analyse disponible. Pour les sites contenant plus de 1 000 URL, plus le contenu et les URL sont conservés. Parce que Google fournira le budget d'analyse le plus élevé possible, mais se concentrera principalement sur les URL les plus centralisées et les mieux gérées.

Limite de taux d'analyse de Google

Lorsque Googlebot explorera les URL, ce sera u.a. déterminé par la soi-disant "limite de taux d'analyse". Googlebot définit lui-même cette limite, en supposant qu'il ajuste le taux d'analyse approprié aux réponses du serveur, ainsi que les éventuels messages d'erreur contenant trop de demandes simultanées ou rapides. La hauteur de cette limite dépend des deux facteurs suivants:

- Nombre de requêtes simultanées du serveur que le bot peut effectuer sur une page Web.

- Intervalle de temps entre les demandes de serveur individuelles.

Un exemple:

Google a déterminé que le budget d'analyse est basé sur 10 connexions simultanées, avec 3 secondes chacune entre les demandes. Dans ce cas, Google 200 peut analyser les URL en une minute.

Cela peut influencer la vitesse d'exploration

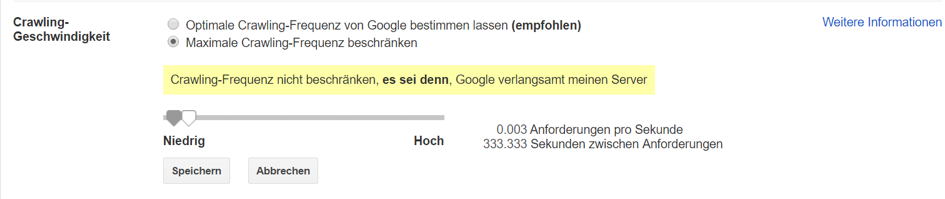

Modifier les paramètres via la console de recherche Google: La limite du taux d’exploration peut être contrôlée par les webmasters directement à partir de la console de recherche Google. Dans la section Paramètres du site Web, vous pouvez sélectionner une analyse plus rapide ou plus lente.

Figure 1: Google crawl speed via Search Console.

À ce stade, il est important de sélectionner une fréquence d'analyse non trop élevée afin que le serveur ne ralentisse pas. De plus, Google ne précise pas combien de temps Googlebot sera finalement sur le site.

Optimiser la vitesse du serveur: Quels que soient les paramètres de la console de recherche, les webmasters doivent avant tout s’assurer que les serveurs répondent rapidement. De cette façon, la vitesse d'exploration peut être considérablement améliorée. Google lui-même recommande de laisser le temps de réponse inférieur à 200 millisecondes. Incidemment, cela ne signifie pas "vitesse de la page". La vitesse du serveur fait référence au temps de réponse du serveur et au nombre possible de connexions simultanées. Cependant, le temps de chargement de la page Web dépend d'autres facteurs tels que le code source ou les scripts et fichiers CSS utilisés.

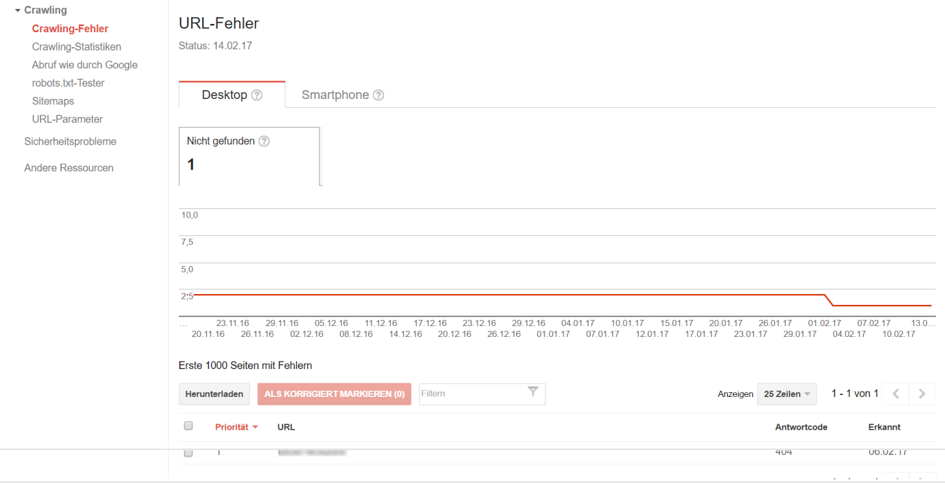

Vérifiez l'erreur du serveur: Dans la console de recherche Google, les erreurs de serveur lors de l'analyse peuvent être vérifiées dans un rapport séparé. (Analyse -> Erreurs d'exploration) Les erreurs, y compris le code d'état correspondant, sont affichées ici.

Figure 2: Consultez les erreurs de serveur avec la console de recherche Google.

Les besoins de Google en matière d'exploration

La vitesse d'exploration d'un site Web par Googlebot est soumise à des limitations techniques. Mais finalement, même sans ces limites, Googlebot peut explorer beaucoup moins de pages que la limite ne l’impose. À cette fin, la soi-disant "demande d'analyse" de Google, si bien que l'analyse est responsable. En abrégé, Googlebot décide si l’exploration d’un site Web en vaut la peine ou si son budget d’exploration doit être épargné.

Dans l'article sur le budget d'analyse mentionné ci-dessus, Google affirme que les pages les plus visitées sont analysées plus souvent, par exemple. La priorisation joue également un rôle dans le choix de l’analyse nécessaire. Le "planificateur" donne la priorité aux URL de sa liste. Les classements suivants sont envisageables ici:

- L'URL est-elle une page d'accueil ou une sous-page? On peut supposer que la page d'accueil a la priorité la plus élevée pour Googlebot. Ce sera toujours en haut de la liste des URL.

- L'URL est-elle précieuse et populaire? Vraisemblablement, les sites Web comportant de nombreux liens entrants, un contenu de haute qualité, un trafic élevé et un faible taux de rebond sont analysés plus souvent que les sites Web affichant des valeurs pires. Quels facteurs jouent un rôle, Google n'a pas publié. Cependant, les facteurs de classement sont vraisemblablement également utilisés pour la hiérarchisation.

- Le contenu change-t-il souvent l'URL? Avec des mises à jour fréquentes des pages, Googlebot sera plus susceptible de connaître une augmentation des besoins en analyse que des URL qui changent à peine.

- À quand remonte la dernière fois que l'URL a été explorée? Si une URL d'une liste n'a pas été explorée pendant une période prolongée, il y a de meilleures chances pour qu'elle reçoive une priorité plus élevée, car Google souhaite maintenir son index à jour.

Une évaluation exacte des extractions de Googlebot peut être obtenue en évaluant les fichiers journaux du serveur.

Cela garantit que les bonnes pages sont rapidement explorées

Évitez les pages orphelines: Les pages orphelines sont des URL auxquelles il est impossible d'accéder via le site Web via des liens internes. Ils ne sont pas aussi utiles pour Googlebot qu’ils le sont pour les utilisateurs.

Lister les URL dans un sitemap XML: À l'aide du sitemap XML, les webmasters peuvent stocker toutes les URL pertinentes d'un domaine dans la console de recherche Google. De cette manière, Googlebot découvre les URL existantes et peut les transmettre au planificateur.

Utilisez le fichier robots.txt: Le fichier robots.txt permet à Googlebot d’analyser toutes les pages Web principales. Par exemple, l’utilisation de robots.txt peut également éviter l’exploration et l’indexation des formulaires de contact.

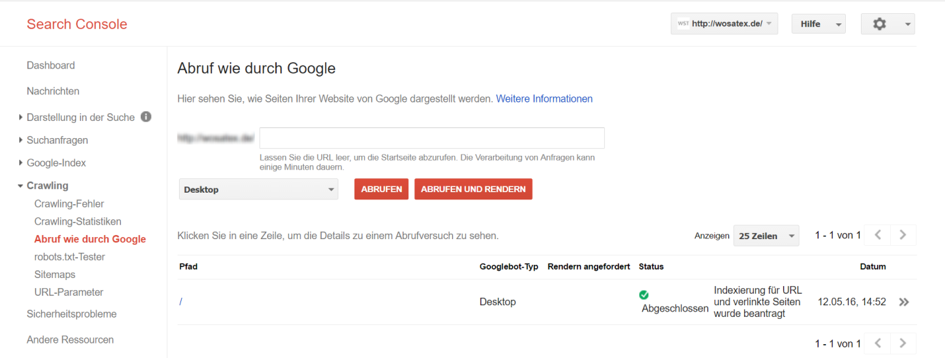

Vérifier le cache d'une page: Google Site Search peut être utilisé pour accéder à des URL individuelles d'un domaine. Cliquez sur "Cache" pour contrôler la dernière inclusion de la page dans l'index. Si le cache a été créé il y a longtemps et que des contenus importants ont changé sur le site Web, l'adresse URL peut également être envoyée manuellement à l'index via la console de recherche.

Figure 3: Envoyer l'URL à l'index Google.

Contrôle de la navigation à facettes: La navigation à facettes peut générer d'innombrables URL grâce aux fonctionnalités de filtrage. Pour le Googlebot, ces "URL de filtre" ne représentent généralement qu'une faible valeur ajoutée, de sorte que la navigation par facettes réduit souvent le budget d'analyse. Pour éviter cela, la structure de cette navigation doit être contrôlée et définie aussi précisément que possible. Par exemple, les URL superflues peuvent être marquées avec une balise Canonical pointant vers la "page d'origine". Il est également possible d'ajouter une balise méta "noindex, follow" à la zone des URL inutiles. L'outil de paramétrage de la console de recherche Google exclut également les paramètres de recherche dans les URL de l'analyse et de l'indexation.

Évitez les URL infinies: Ces types d'URL peuvent provenir à la fois de capacités de recherche sur l'ensemble de la page et de liens "Continuer" sur la page. L'exclusion des résultats de la recherche interne de l'analyse peut économiser considérablement le budget d'analyse.

Utilisez les pages d'erreur 404: Pour éviter l'exploration infinie de pages logicielles 404, les URL inexistantes doivent générer le code 404 (introuvable). Cela empêchera Googlebot de continuer à explorer ces URL, ce qui réduirait le budget d'exploration.

conclusion

Googlebot ne prend que peu de temps pour analyser votre page. Mais en corrigeant les erreurs techniques, vous pouvez améliorer l’exploration. Dans le même temps, il est important que Google reconnaisse le besoin d'analyse, et à ce stade, l'utilisation du budget d'analyse devient un sujet essentiel de l'optimisation des moteurs de recherche. Après tout, cela dépend de la qualité de votre site Web, de la fréquence à laquelle Googlebot le visite. Ainsi, par exemple, vous pouvez contribuer à travers un contenu unique et de haute qualité pour tirer le meilleur parti du budget d'analyse.